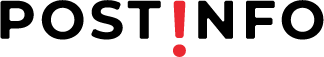

Veštačka inteligencija ne greši uvek tako da odmah deluje pogrešno. Naprotiv, njena najveća snaga i najveća opasnost često su ista stvar: samouveren ton. Zato je jučerašnji tekst na Computer Hoy privukao pažnju jednostavnom idejom da postoji mali praktični metod kojim korisnik može proveriti da li chatbot zaista zna odgovor ili ga samo ubedljivo izmišlja. U tekstu se to zove „Cupcake“ trik, a suština nije u nekoj magičnoj komandi, već u namernom ubacivanju provere koja tera model da se razotkrije kada počne da halucinira. Portal ga je predstavio kao način da se odvoji stvarni podatak od digitalne samouverenosti koja zvuči potpuno uverljivo čak i kada nema čvrsto uporište.

Zanimljivo je što ova tema pogađa samu psihologiju odnosa čoveka i mašine. Ljudi prirodno veruju onome što zvuči glatko, uređeno i brzo, a upravo to je stil u kome chatbotovi najlakše isporučuju pogrešku. U tom smislu, problem nije samo tehnički, nego i ljudski: model halucinira, ali korisnik često želi da mu veruje jer odgovor dolazi bez napora, bez kolebanja i bez onog neprijatnog „ne znam“. Computer Hoy je zato juče, možda i više nego tehnološki, otvorio jednu novu digitalnu pismenost — ne kako dobiti odgovor, nego kako posumnjati u odgovor koji deluje previše uglačano.

Možda je baš to sledeća velika navika koju će ljudi morati da steknu. Nekada se učilo da ne treba verovati svemu što piše na internetu; sada se sve više uči da ne treba verovati ni svemu što vam internet samouvereno napiše u jednoj rečenici. I zato su mali testovi, pomoćna pitanja i namerno traženje potvrde važniji nego što deluju. U svetu u kom mašina govori tečno, sposobnost da joj se ne poveruje odmah postaje jedna od osnovnih veština.

S.B.